Calcolo ad alte prestazioni (HPC) e intelligenza artificiale: quali sfide per l'infrastruttura dei data center?

Da vent'anni, il calcolo ad alte prestazioni (HPC) sta rivoluzionando gli utilizzi sia grazie alla sua potenza in continua evoluzione sia per la sua rapida diffusione in numerosi settori. L'intelligenza artificiale svolge un ruolo fondamentale in questi progressi e in questa fulminea democratizzazione, è innegabile. A dirla tutta, IA e HPC sono intrinsecamente legate. Sì, ma l'IA, abbinata all'uso massiccio del calcolo intensivo, richiede enormi risorse. Si pone quindi la questione della struttura dei data center: come ospitare una tale potenza? Quali sono gli impatti di risorse così gigantesche? Quali tecnologie (DLC, PDU ad alta densità, ecc.) consentono di mantenere la rotta?

Calcolo intensivo o HPC (High Performance Computing): di cosa si tratta?

L'HPC, ovvero il calcolo intensivo o calcolo ad alte prestazioni, consiste nell'utilizzo di supercomputer e sistemi di calcolo parallelo per eseguire processi di calcolo estremamente complessi, di grandi dimensioni e ad alta velocità. Questi sistemi sono in grado dielaborare trilioni, se non addirittura quadrilioni, di operazioni al secondo.

Il calcolo ad alte prestazioni riesce così a fornire risposte di estrema precisione a problematiche di natura scientifica, ingegneristica o relative all'analisi dei dati.

Oggi questi calcoli consentono di simulare test ed esperimenti di laboratorio che non sempre si basavano su procedure etiche. È il caso, ad esempio, dei test sugli animali, un tempo ampiamente utilizzati nel settore della cosmetologia.Il calcolo intensivo rende ormai queste pratiche praticamente obsolete.

Il ruolo dell'intelligenza artificiale nell'HPC

Fino a pochi anni fa, l'HPC veniva utilizzato solo sporadicamente dai centri di ricerca, da alcuni settori industriali ben specifici o dalle università.Oggi, l'uso dell'HPC si è ampiamente diffuso.

Questo fenomeno è dovuto all'intelligenza artificiale, che è venuta a completare e rivoluzionare il settore dell'HPC. In concreto, è importante sottolineare un punto:il calcolo intensivo e l'IA sono intrinsecamente legati.

Ecco alcuni elementi a sostegno di questa tesi:

→ L'IA accelera i calcoli

Infatti, grazie ad algoritmi di ultima generazione, sviluppati sulla basedelle reti neurali profonde(DNN), che imitano il funzionamento del buon vecchio cervello umano, è possibile eseguire più rapidamente le operazioni di calcolo intensivo.

→ L'IA consente l'ottimizzazione delle risorse di calcolo

L'intelligenza artificiale è quindi in grado di prevedere il modo migliore per distribuire i compiti di calcolo tra i diversi nodi di un supercomputer.

→ L'intelligenza artificiale migliora gli algoritmi di simulazione

IlMachine Learning, ma soprattutto le reti neurali profonde (DNN), consentono di migliorare la precisione delle simulazioni di fenomeni complessi, adattando i modelli in base ai nuovi dati integrati.

→ L'intelligenza artificiale consente l'analisi di grandi quantità di dati

L'HPC genera di per sé un'enorme quantità di dati. L'IA dispone delle risorse necessarie per analizzare queste enormi quantità di informazioni.

Da vent'anni, il calcolo ad alte prestazioni (HPC) sta rivoluzionando gli utilizzi sia grazie alla sua potenza in continua evoluzione sia per la sua rapida diffusione in numerosi settori. L'intelligenza artificiale svolge un ruolo fondamentale in questi progressi e in questa fulminea democratizzazione, è innegabile. A dirla tutta, IA e HPC sono intrinsecamente legate. Sì, ma l'IA, abbinata all'uso massiccio del calcolo intensivo, richiede enormi risorse. Si pone quindi la questione della struttura dei data center: come ospitare una tale potenza? Quali sono gli impatti di risorse così gigantesche? Quali tecnologie (DLC, PDU ad alta densità, ecc.) consentono di mantenere la rotta?

Calcolo intensivo o HPC (High Performance Computing): di cosa si tratta?

L'HPC, ovvero il calcolo intensivo o calcolo ad alte prestazioni, consiste nell'utilizzo di supercomputer e sistemi di calcolo parallelo per eseguire processi di calcolo estremamente complessi, di grandi dimensioni e ad alta velocità. Questi sistemi sono in grado dielaborare trilioni, se non addirittura quadrilioni, di operazioni al secondo.

Il calcolo ad alte prestazioni riesce così a fornire risposte di estrema precisione a problematiche di natura scientifica, ingegneristica o relative all'analisi dei dati.

Oggi questi calcoli consentono di simulare test ed esperimenti di laboratorio che non sempre si basavano su procedure etiche. È il caso, ad esempio, dei test sugli animali, un tempo ampiamente utilizzati nel settore della cosmetologia.Il calcolo intensivo rende ormai queste pratiche praticamente obsolete.

Il ruolo dell'intelligenza artificiale nell'HPC

Fino a pochi anni fa, l'HPC veniva utilizzato solo sporadicamente dai centri di ricerca, da alcuni settori industriali ben specifici o dalle università.Oggi, l'uso dell'HPC si è ampiamente diffuso.

Questo fenomeno è dovuto all'intelligenza artificiale, che è venuta a completare e rivoluzionare il settore dell'HPC. In concreto, è importante sottolineare un punto:il calcolo intensivo e l'IA sono intrinsecamente legati.

Ecco alcuni elementi a sostegno di questa tesi:

→ L'IA accelera i calcoli

Infatti, grazie ad algoritmi di ultima generazione, sviluppati sulla basedelle reti neurali profonde(DNN), che imitano il funzionamento del buon vecchio cervello umano, è possibile eseguire più rapidamente le operazioni di calcolo intensivo.

→ L'IA consente l'ottimizzazione delle risorse di calcolo

L'intelligenza artificiale è quindi in grado di prevedere il modo migliore per distribuire i compiti di calcolo tra i diversi nodi di un supercomputer.

→ L'intelligenza artificiale migliora gli algoritmi di simulazione

IlMachine Learning, ma soprattutto le reti neurali profonde (DNN), consentono di migliorare la precisione delle simulazioni di fenomeni complessi, adattando i modelli in base ai nuovi dati integrati.

→ L'intelligenza artificiale consente l'analisi di grandi quantità di dati

L'HPC genera di per sé un'enorme quantità di dati. L'IA dispone delle risorse necessarie per analizzare queste enormi quantità di informazioni.

“In realtà, il calcolo ad alte prestazioni non è altro che un livello sottostante dell’intelligenza artificiale.”

Renaud de Saint Albin, amministratore delegato e fondatore di Module IT

La diffusione su larga scala dell'HPC nei vari settori di attività

Il calcolo intensivo è ormai utilizzato da quasi tutti i settori industrialie da un numero sempre crescente di ambiti di attività. Di seguito è riportato un elenco non esaustivo dei settori che si avvalgono dei supercomputer per diverse simulazioni, analisi e sperimentazioni, con alcuni esempi di casi d’uso.

- Banca e finanza:analisi dei dati, modellizzazione finanziaria, gestione della blockchain, ecc.

- Ricerca scientifica:meteorologia, in particolare simulazioni climatiche, ricerca farmaceutica, biologia, ecc.

- Settore automobilistico:simulazioni di crash test, progettazione di veicoli e ottimizzazione delle prestazioni, ecc.

- Energia:simulazioni di centrali elettriche, ricerche sulle energie rinnovabili, ecc.

IA e HPC: quali sono le ripercussioni sul consumo energetico dei data center?

L'impennata del fabbisogno energetico e del consumo elettrico dei data center

Mettiamo subito le cose in prospettiva: l'andamento del consumo elettrico non è proporzionale all'aumento di potenza, e per fortuna! Tuttavia, rimane comunque molto consistente, e ciò è dovuto a diversi fattori:

→ L'aumento della potenza delle singole CPU (Central Processing Unit):

Con l'arrivo sul mercato di CPU sempre più potenti, il consumo energetico è di fatto maggiore per consentire loro di funzionare a pieno regime. Ciò è dovuto alla necessità di elaborare un numero maggiore di operazioni al secondo, il che aumenta logicamente il consumo di energia elettrica ad ogni ciclo di calcolo.

→ L'ondata delle GPU (Graphic Processing Unit)

Qual è il punto di forza di questi nuovi componenti? La loro capacità di elaborare contemporaneamente una serie di attività e operazioni. Il rovescio della medaglia, tuttavia, è l'enorme consumo energetico che queste elaborazioni parallele comportano.

→ L'intensificazione delle infrastrutture

In particolare per quanto riguarda CPU e GPU per U (unità di rack). Negli ultimi due decenni, la potenza media di un rack da 42U a pieno carico era compresa tra 3 e 5 kW. I rack più densi raggiungevano invece valori compresi tra 10 e 12 kW.

E oggi, quando si parla di sistemi informatici di dimensioni «modeste», la densità media per rack si attesta tra i 30 kW e i 60 kW. E per sistemi informatici di dimensioni modeste intendiamo i centri di ricerca regionali, le grandi aziende del settore automobilistico o ancora gli operatori della produzione audiovisiva. Questo vi dà un'idea dell'enorme evoluzione che ha avuto luogo in appena 20 anni!

Il tiering: una soluzione alla questione del consumo energetico nel calcolo intensivo?

Come è noto, la potenza richiesta oggi negli armadi server èda 5 a 10 volte superiorea quella comunemente utilizzata nell'informatica tradizionale. A ciò si aggiunge un'ulteriore esigenza: quelladell'alta disponibilità che queste infrastrutture devono garantire.Si tratta di una condizioneimprescindibile chemolti dei settori sopra citati devono assolutamente soddisfare.

Il ricorso a una tariffazione differenziata sembra quindi una soluzione opportuna per ridurre (o almeno contenere) il consumo elettrico.Consente così, di tanto in tanto, di spegnere le infrastrutture senza conseguenze.

Nel mondo dei data center, il Tiering è il sistema che classifica, valuta e certifica l'affidabilità e la disponibilità di un sistema. Si articola in una struttura suddivisa in diversi livelli: dal più basilare(Tier I)al più disponibile(Tier IV).

Per i settori che richiedono un'elevata disponibilità, lo standard Tier III è quello più comunemente utilizzato (massimo 1 o 2 ore di interruzione all'anno). In altri ambiti, un'interruzione di un giorno può essere considerata un compromesso accettabile, soprattutto se ciò consente di ottenere notevoli risparmi (sia in termini di OPEX che di CAPEX).

Quali soluzioni esistono per arginare il problema del raffreddamento degli armadi per il calcolo intensivo?

Il raffreddamento delle sale server: una sfida non da poco

Il raffreddamento è senza dubbio la fase tecnica più influenzatadallo sviluppo delle infrastrutture di calcolo nei data center.

Dissipare il calore generato da questi rack rappresenta una sfida importante, che richiede soluzioni di raffreddamento sofisticate, ma talvolta estremamente costose. Queste soluzioni possono essere ingombranti e non necessariamente molto efficaci o sicure nel mantenere le temperature desiderate entro i limiti operativi.

Il sistema di raffreddamento ha il complesso compito di affrontare le seguenti sfide:

→ La densità per vano da trattare

Ci si riferisce qui alla potenza di calcolo complessiva e, di conseguenza, alla produzione di calore concentrata in un rack di server. Un'elevata densità comporta una maggiore emissione di calore in uno spazio ridotto, rendendo così più complessa la refrigerazione.

→ Il calore totale da smaltire

Si tratta della quantità totale di calore generata da tutte le apparecchiature di un data center. La difficoltà sta nel riuscire a dissipare efficacemente il calore per mantenere una temperatura operativa adeguata.

→ L'ottimizzazione delle condizioni ambientali

Si tratta in questo caso di poter regolare la temperatura e il flusso d'aria all'interno del data center, in modo che il raffreddamento avvenga senza danneggiare le apparecchiature.

→ La necessaria ricerca della redditività…

… grazie a soluzioni di raffreddamento che riescono a ridurre al minimo il consumo energetico, garantendo al contempo un'adeguata dissipazione del calore generato.

Maggiore sarà l'efficienza del sistema di raffreddamento, minori saranno i costi operativi del data center (senza contare il suo impatto ambientale).

Le porte refrigerate: un sistema efficace, ma con alcuni limiti

Alla fine degli anni 2000 sono state introdotte sul mercato le porte refrigerate, attive o passive, per gestire il calore generato dagli armadi a densità molto elevata.

Questi dispositivi sono ancora oggi in uso e funzionanocon densità fino a 35 kW per rack (con una temperatura dell'acqua in ingresso piuttosto bassa: 12-13 °C). Esistono numerosi produttori di questi dispositivi. Ne citiamo ad esempio Schroff, Atos Racks e Vertiv.

La porta refrigerata è una soluzione che presenta il vantaggio di non alterare l'ambiente esistente: la stragrande maggioranza del calore generato dall'armadio HPC viene trattata alla fonte e non influisce sul resto dell'ambiente della sala.

Punto di attenzione

Il sistema di raffreddamento con porte refrigerate presenta alcuni limiti:

- Le temperature dell'acqua in ingresso rimangono basse, inferiori a 15 °C, per garantire una capacità di raffreddamento sufficiente.

- In caso di guasto al sistema, la temperatura nella parte posteriore degli armadi aumenta molto rapidamente a causa dello scarso ricambio d'aria,

- La ridondanza dei vari componenti della porta è limitata (spesso limitata ai ventilatori), il che limita la disponibilità complessiva del sistema (manutenzione, guasti),

- Il sistema è rumoroso e occorre tenere conto delle sue dimensioni in caso di installazione in uno spazio ristretto.

Il sistema DLC (Direct Liquid Cooling) viene in soccorso!

In questa sede parleremo delsistema DLC (o raffreddamento a liquido diretto) inteso come raffreddamento interno all'interno di un armadio o di un rack tradizionale. Tralasceremo volutamente il sistema a immersione, in cui le apparecchiature IT vengono immerse direttamente in un liquido refrigerante.

Riteniamo infatti che quest'ultima tecnica comporti una serie di limitazioni, nonostante la sua soddisfacente efficacia teorica.

→ Per saperne di più, scarica la nostra Guida tecnica, in cui trattiamo l'argomento dei metodi di raffreddamento in modo più approfondito.

L'obiettivo del sistema di raffreddamento a liquido (LCD) è quello di recuperare il calore direttamente dal cuore del server, proprio dove viene dissipato. Il calore viene recuperato tramite piastre posizionate sui componenti che generano calore (CPU, GPU, RAM, alimentatore, ecc.). L'acqua o il liquido scorre quindi attraverso queste piastre per assorbire il calore. Esistono diversi sistemi di raffreddamento a liquido.

Tuttavia, non esiste ancora uno standard che consenta l'interoperabilità tra tutti questi sistemi. Di conseguenza, le infrastrutture di raffreddamento continuano a dipendere in larga misura dai produttori di server.

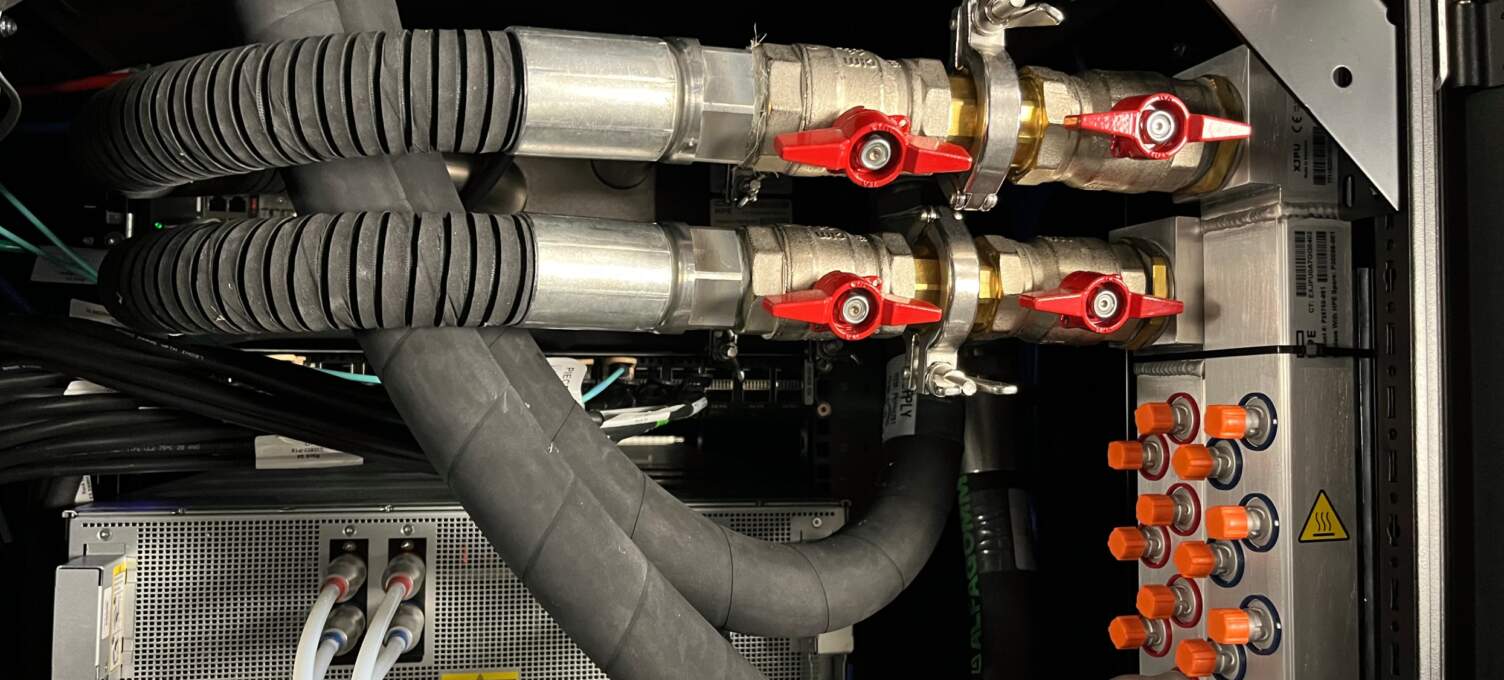

Composizione e tipologia di un sistema di raffreddamento DLC

Un sistema di raffreddamento DLC è composto come segue:

- di un impianto di refrigerazione odi scambio termico dell'impianto

- di unaCDU (oCooling Distribution Unit)che gestisce la portata, la pressione e la temperatura dell'acqua o del liquido utilizzato per raffreddare i server.

- uncollettore dell'armadio(andata e ritorno) che distribuisce e recupera il liquido nelle diverse apparecchiature IT.

- apparecchiature IT(server) predisposte per il raffreddamento interno (cold-plate, ingresso-uscita del liquido).

Infine, va sottolineato che sul mercato esistono due tipi di CDU:

1.Le CDU cosiddette «rackable»(ovvero le unità progettate per essere installate direttamente in un rack o in un armadio metallico). Queste unità gestiscono l'alimentazione e il ricircolo del liquido per un rack e sono in grado di gestire fino a 200 kW occupando solo 4U all'interno del rack.

© COOLIT SYSTEMS

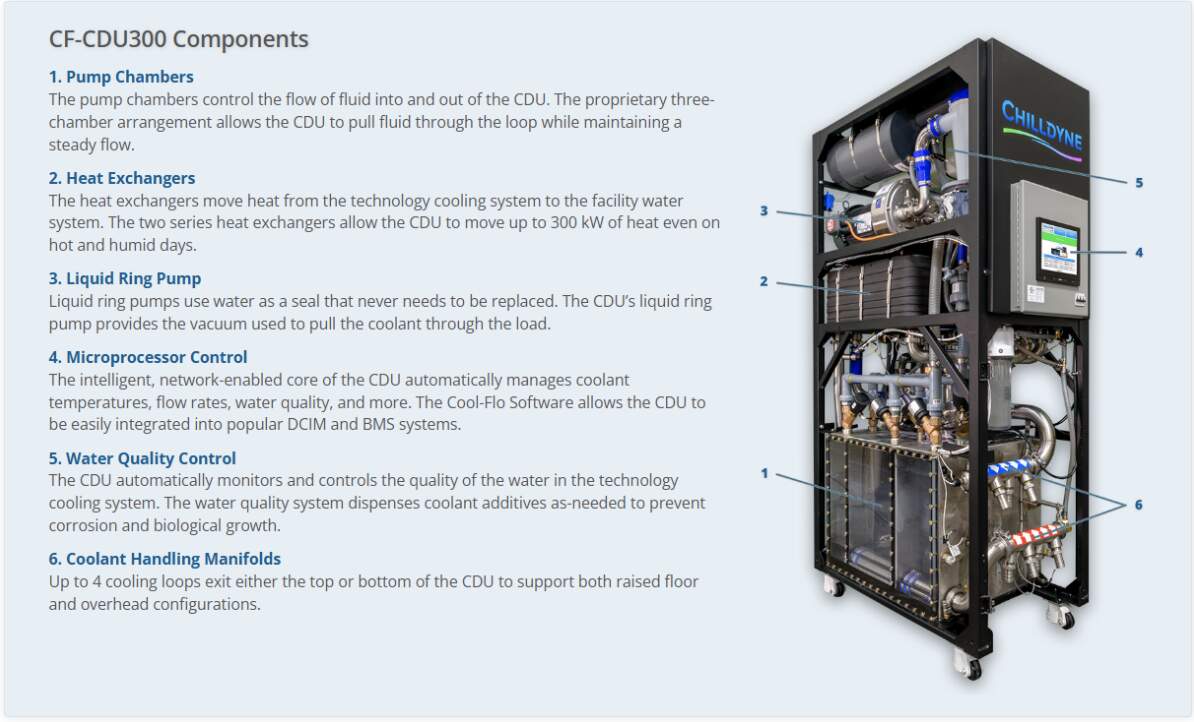

2.Le CDU «in fila»(ovvero quelle progettate appositamente per essere collocate nei corridoi o nelle file di rack di un data center). Sono in grado di gestire più rack contemporaneamente, fino a oltre 1,5 MW, con un ingombro a terra più o meno equivalente a quello di un rack per server (più o meno profondo o largo a seconda del produttore).

2024 Chilldyne, Inc.

Conclusione

Abbiamo ancora molto da dire sulle metodologie di raffreddamento: per saperne di più, continuate a seguire i nostri nuovi contenuti oppure contattateci!

Va inoltre sottolineato che viviamo in un mondo tecnologico che evolve a una velocità che solo pochi decenni fa non era nemmeno immaginabile. Questi sistemi, che abbiamo esaminato a lungo, diventeranno obsoleti entro 10 o 20 anni? Con l'ascesa dei supercomputer quantistici, che stanno iniziando a far parlare di sé e che cambieranno chiaramente le carte in tavola, verrebbe da dire: forse... Ma solo il futuro ce lo dirà con certezza!